Flexotechcard

PDF-макеты превращаются в техкарту через ResNet, bouncing-проверки и каскад CatBoost.

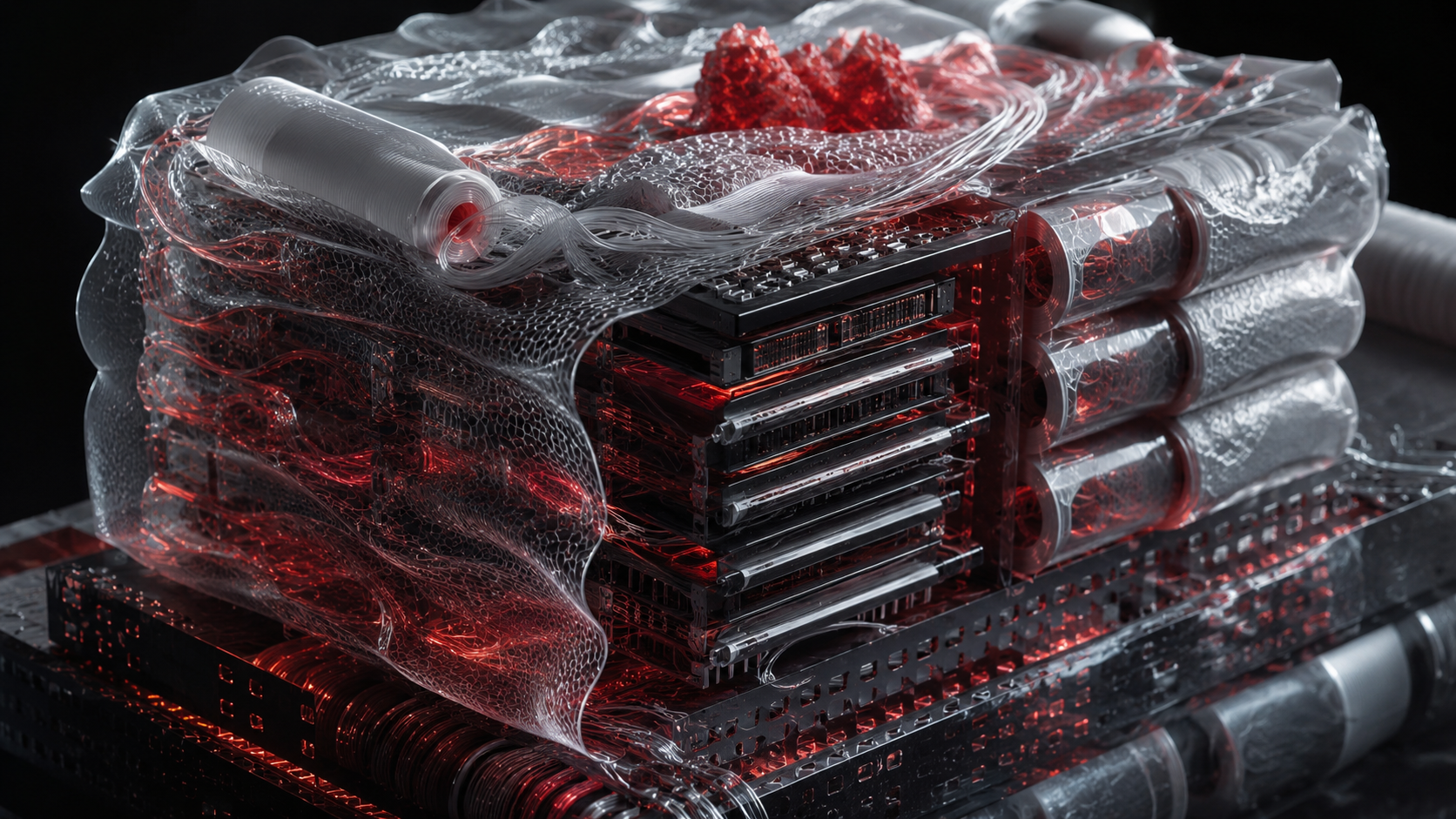

2А развивает десятки прикладных ML-систем для флексопечати и производственных процессов. На лендинге показаны 5 разных кейсов, уже работающих внутри компании. Цель гранта — собрать единый ресурс для инференса, обучения и экспериментов: GPU, storage, очереди batch-задач и self-hosted LLM-контур.

Ниже — пять уже работающих систем: сначала их можно быстро просканировать, затем перейти к инфраструктурной логике и детальным кейсам по каждому направлению.

PDF-макеты превращаются в техкарту через ResNet, bouncing-проверки и каскад CatBoost.

Технологи получают ответы по техкартам и дефектологии в рабочем контуре через локальный retrieval.

ASR, speaker identity и оценка качества превращают звонки в масштабируемый QA-контур.

Система выравнивает макеты и изображения, находит расхождения и информирует о изменениях.

ML достраивает недостающие параметры заказа, а формульное ядро считает себестоимость и бизнес-логику.

Все продукты работают на внутренних чувствительных производственных данных: макеты, техкарты, заказы, голоса операторов, дефектология, расчёты. Компания постоянно дообучает модели, переоценивает качество и имеет стабильный загруженный инференс. Для нас является важным шагом обьединение всех контуров в единую инфраструктуру.

DINO обучалась на макетах компании, GigaAM дообучалась на внутренних звонках, CatBoost и KNN опираются на производственную историю. Пайплайн обновляется по мере появления новых данных.

CV, ASR, retrieval и калькуляторы уже задействованы в рабочих задачах. Нужен стабильный compute-контур.

Звонки, макеты, техкарты и себестоимость остаются внутри компании. Это требует self-hosted среды для модели, индексов, артефактов и чекпоинтов, необходимо минимизировать зависимость от сторонних вендеров LLM.

Грант Selectel нужен, чтобы собрать единый AI-runtime: GPU, S3-совместимое хранение, выделенные сервисы для retrieval и безопасные среды для train/staging.

Стек собирает сигналы из нескольких контуров: ResNet достаёт визуальные признаки из PDF-макета, bouncing-проверка ищет опасные зоны стыка и перекрытий, а каскад CatBoost-моделей доводит это до техкарты для печати.

Не единый классификатор, а ветковидный производственный пайплайн: visual features, физические ограничения, доменная логика и post-processing должны жить в одном стабильном runtime.

Batch inference по PDF-макетам и переобучение визуального контура упираются в compute.

GPU для train/infer по макетам, S3 для моделей, чекпоинтов и исторических feature-артефактов.

Ускорить цикл переобучения и протестировать более тяжёлые backbone вместо упора в CPU-only сценарии.

Локальный RAG-сервис для технологов и печатников. Поиск по исторческим техкартам, рецептам и дефектологии -> ответ в рабочем контуре через Bitrix

Hybrid search реализован следующим образом: dense + sparse ветки, RRF fusion, metadata filters, delete-by-source при reingest и eval-утилиты Recall/MRR/nDCG. Санитизированная SQLite-база техкарт содержит 407151 строку, следующий шаг — заменить внешний inference собственным доменным обученным LLM-контуром.

LLM inference и суммаризация зависят от внешних вендоров, а vector-контур живёт отдельно от общего runtime.

GPU под Qwen-class inference и fine-tune, выделенный runtime для Qdrant, storage для индексов и эмбеддингов.

Обучить доменную LLM на базе техкарт и дефектологии, убрать зависимость от внешнего API в production.

Контур анализирует звонки отделов: распознаёт речь, отделяет оператора от клиента, привязывает результат к конкретному голосовому отпечатку и формирует оценку качества. Стек: pyannote, nvidia nemotron, silero vad. GigaAM v3 работает локально и дообучалась на внутренних звонках компании.

Speaker identity идёт через галерею операторов, embeddings и KNN/PLDA-контур. Это позволяет оценивать качество по конкретному сотруднику и формировать понятный отчет в конце месяца по каждому сотруднику.

ASR построен на GigaAM v3 e2e RNN-T, адаптированной на внутренних разговорах. Silero VAD убирает тишину, на выходе - timestamp транскрибация с отчетом по ключевым критерям.

LLM заполняет долгосрочную память по звонкам, формирует графовую память по каждому сотруднику.

Уже обработанные GPT-отчёты используются как teacher-сигнал. Следующий этап — дистиллировать Qwen для массовой локальной оценки качества без дорогого внешнего inference.

GigaAM и pyannote требуют GPU для приемлемой скорости, а массовая оценка качества пока слишком дорога на внешнем inference из-за LLM.

GPU для batch-обработки звонков, S3 для аудио-артефактов и отчётов, ресурс под дистилляцию Qwen на размеченных данных.

Перевести QA-оценку звонков в локальный контур и масштабировать анализ на весь поток звонков.

Synaplex сравнивает цифровой макет и контрольное изображение, выравнивает пары через alignment pipeline и строит heatmap расхождений. DINO дообучена на макетах компании и используется как производственный feature-контур.

Синтетический датасет для дообучения, полностью локальный контур проверки, путь от homography > dino change detection > yolo text detector > OCR > проверка орфографии fuzzy алгоритмами

DINO inference и дообучение change-detection контура слишком тяжёлые для текущих ресурсов.

GPU для DINO/Open-CD train/infer, S3 для отчетов, alignment-артефактов и checkpoint storage.

Собрать CV-контур для станков и перейти от единичных проверок к системному batch-контролю макетов.

Калькулятор себестоимости продукции, модель предсказывает недостающие печатные параметры по историческим заказам для новых заказчиков. Дальше расчёт идёт через детерминированное формульное ядро и формирует бизнес-процесс.

Нужен общий ресурс для масштабирования расчётов на большее число сценариев и построения ML-контура вокруг экономики заказов.

CPU/staging-серверы, S3 для истории заказов и ML-артефактов, отдельная среда для экспериментов с формулами и моделями.

Контур будет масштабироваться на все расчёты компании, формируя сетку моделей для предсказания экономических показателей: себестоимость, чувствительность к параметрам заказа, поведение материалов и отклонения от ожидаемой маржи.

Здесь нужны трансформеры для работы с разнородными таблично-текстовыми входами, историей заказов, спецификациями и последующего извлечения скрытых экономических зависимостей между типом заказа, материалом, печатью и итоговой экономикой.

Грант необходим на сборку общего слоя для уже работающих систем: единый GPU/runtime для train+infer, self-hosted inference и доменные модели, а также дальнейшее масштабирование AI-контуров на новые производственные и экономические задачи.

Поднять общий GPU-контур для DINO, ASR и тяжёлого inference, вынести артефакты и датасеты в общий storage и собрать повторяемый batch-runtime для обучения и эксплуатации.

Запустить дистилляцию Qwen, укрепить retrieval без внешнего API и перевести часть inference в собственный доменный model layer.

Расширить AI-runtime на новые контуры компании: доменная LLM, CV-контуры для станков и сетка моделей для расчётных, производственных и аналитических сценариев.